人工智能產(chǎn)業(yè)鏈全景與基礎(chǔ)軟件開(kāi)發(fā)核心解析

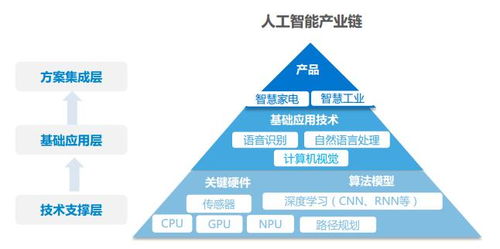

人工智能作為引領(lǐng)新一輪科技革命和產(chǎn)業(yè)變革的戰(zhàn)略性技術(shù),其產(chǎn)業(yè)鏈條已日趨成熟和完善。一個(gè)完整的人工智能產(chǎn)業(yè)鏈通常自上而下劃分為基礎(chǔ)層、技術(shù)層和應(yīng)用層。其中,基礎(chǔ)層的核心之一是人工智能基礎(chǔ)軟件開(kāi)發(fā),它是整個(gè)產(chǎn)業(yè)大廈的基石與引擎。

人工智能產(chǎn)業(yè)鏈全景概述

- 基礎(chǔ)層:提供計(jì)算能力、數(shù)據(jù)和基礎(chǔ)軟件支撐。

- 硬件設(shè)施:包括AI芯片(如GPU、TPU、NPU等)、傳感器、服務(wù)器、云計(jì)算數(shù)據(jù)中心等,為AI提供強(qiáng)大的算力基礎(chǔ)。

- 數(shù)據(jù)資源:涵蓋數(shù)據(jù)采集、清洗、標(biāo)注和管理,是訓(xùn)練AI模型的“燃料”。

- 基礎(chǔ)軟件:即本文重點(diǎn),包括操作系統(tǒng)、開(kāi)發(fā)框架、算法庫(kù)等,是連接硬件與應(yīng)用的關(guān)鍵橋梁。

- 技術(shù)層:基于基礎(chǔ)層的資源,研發(fā)核心AI技術(shù)與算法模型。

- 算法與模型:如機(jī)器學(xué)習(xí)、深度學(xué)習(xí)、計(jì)算機(jī)視覺(jué)、自然語(yǔ)言處理、語(yǔ)音識(shí)別等領(lǐng)域的核心算法。

- 通用技術(shù)平臺(tái):將算法模型封裝成可供調(diào)用的API或SDK,降低技術(shù)使用門檻。

- 應(yīng)用層:將AI技術(shù)集成到具體產(chǎn)品和解決方案中,賦能千行百業(yè)。

- 行業(yè)解決方案:如智慧金融、智能醫(yī)療、自動(dòng)駕駛、智慧城市、智能制造等。

- 消費(fèi)級(jí)產(chǎn)品:如智能音箱、人臉識(shí)別門禁、推薦系統(tǒng)、智能客服等。

人工智能基礎(chǔ)軟件開(kāi)發(fā):產(chǎn)業(yè)鏈的“操作系統(tǒng)”

人工智能基礎(chǔ)軟件開(kāi)發(fā)位于產(chǎn)業(yè)鏈基礎(chǔ)層,其核心目標(biāo)是將底層的硬件算力高效、便捷地釋放給上層的算法開(kāi)發(fā)者和應(yīng)用構(gòu)建者。它主要包括以下幾個(gè)關(guān)鍵組成部分:

1. AI開(kāi)發(fā)框架與平臺(tái)

這是基礎(chǔ)軟件的核心。主流框架如TensorFlow(谷歌)、PyTorch(Meta/PyTorch基金會(huì))、PaddlePaddle(百度) 等,它們提供了構(gòu)建、訓(xùn)練和部署神經(jīng)網(wǎng)絡(luò)模型的完整工具鏈。這些框架通過(guò)高度抽象的編程接口,屏蔽了底層硬件的復(fù)雜性,讓研究人員和工程師能夠?qū)W⒂谀P驮O(shè)計(jì)與算法創(chuàng)新。

2. AI計(jì)算引擎與運(yùn)行時(shí)庫(kù)

這是框架之下的“發(fā)動(dòng)機(jī)”。例如NVIDIA的CUDA和cuDNN,是針對(duì)其GPU硬件優(yōu)化的并行計(jì)算平臺(tái)和深度學(xué)習(xí)加速庫(kù)。它們直接管理硬件資源,將框架定義的計(jì)算圖高效地映射到芯片上執(zhí)行,極大提升了訓(xùn)練和推理效率。國(guó)產(chǎn)芯片廠商也都在積極打造自己的計(jì)算引擎和算子庫(kù)。

3. AI編譯器與工具鏈

隨著AI模型和硬件架構(gòu)日益復(fù)雜,編譯器的作用愈發(fā)關(guān)鍵(如TVM、MLIR)。它負(fù)責(zé)將來(lái)自不同框架的模型,進(jìn)行跨平臺(tái)優(yōu)化、編譯,使其能夠在各種芯片(CPU、GPU、ASIC等)上以最優(yōu)性能運(yùn)行。工具鏈則包括調(diào)試、性能分析、可視化(如TensorBoard)等一系列輔助工具。

4. AI分布式系統(tǒng)與調(diào)度軟件

為了應(yīng)對(duì)大規(guī)模模型訓(xùn)練的海量數(shù)據(jù)和算力需求,需要強(qiáng)大的分布式系統(tǒng)軟件。例如Kubernetes用于容器化管理和資源調(diào)度,結(jié)合特定的AI調(diào)度器(如Kubeflow),可以高效地在集群中管理和協(xié)調(diào)成千上萬(wàn)個(gè)計(jì)算任務(wù)。

5. 數(shù)據(jù)管理與處理工具

高質(zhì)量的數(shù)據(jù)流水線是AI開(kāi)發(fā)的前提。這包括數(shù)據(jù)版本控制(如DVC)、特征存儲(chǔ)、自動(dòng)化數(shù)據(jù)標(biāo)注平臺(tái)以及大數(shù)據(jù)處理工具(如Apache Spark)等,確保數(shù)據(jù)能被高效、可靠地用于模型訓(xùn)練。

基礎(chǔ)軟件開(kāi)發(fā)的重要性與趨勢(shì)

- 降低門檻與提升效率:優(yōu)秀的基礎(chǔ)軟件極大降低了AI研發(fā)和部署的技術(shù)與成本門檻,加速了AI技術(shù)的普及和創(chuàng)新迭代速度。

- 硬件效能的關(guān)鍵:決定了底層算力硬件(尤其是各類AI芯片)的性能能否被充分發(fā)揮,是硬件商業(yè)成功的軟實(shí)力保障。

- 產(chǎn)業(yè)生態(tài)的核心:主流開(kāi)發(fā)框架往往能匯聚龐大的開(kāi)發(fā)者社區(qū),形成強(qiáng)大的生態(tài)系統(tǒng),進(jìn)而影響整個(gè)產(chǎn)業(yè)鏈的技術(shù)標(biāo)準(zhǔn)和發(fā)展方向。

當(dāng)前,AI基礎(chǔ)軟件領(lǐng)域呈現(xiàn)以下趨勢(shì):

- 軟硬件協(xié)同優(yōu)化:針對(duì)特定領(lǐng)域(如大模型)的芯片與配套軟件棧深度耦合設(shè)計(jì),追求極致性能。

- 開(kāi)源與生態(tài)競(jìng)爭(zhēng):開(kāi)源已成為構(gòu)建生態(tài)的主流模式,全球范圍內(nèi)圍繞主流框架的生態(tài)競(jìng)爭(zhēng)日益激烈。

- 全棧化與自動(dòng)化:從數(shù)據(jù)準(zhǔn)備、模型訓(xùn)練、優(yōu)化到部署監(jiān)控的全流程工具鏈日趨完善,并向著自動(dòng)化、低代碼/無(wú)代碼方向發(fā)展。

- 安全與可信:隨著AI深入應(yīng)用,模型安全、隱私保護(hù)、可解釋性等需求正被集成到基礎(chǔ)軟件的設(shè)計(jì)之中。

###

總而言之,人工智能基礎(chǔ)軟件開(kāi)發(fā)是人工智能產(chǎn)業(yè)鏈中至關(guān)重要且技術(shù)密集的一環(huán)。它不僅是釋放算力潛能的“轉(zhuǎn)換器”,更是匯聚創(chuàng)新、培育生態(tài)的“土壤”。隨著人工智能技術(shù)向更大規(guī)模、更廣場(chǎng)景、更深融合演進(jìn),基礎(chǔ)軟件的創(chuàng)新與突破將繼續(xù)扮演決定性的角色,為整個(gè)產(chǎn)業(yè)的繁榮發(fā)展提供源源不斷的底層動(dòng)力。

如若轉(zhuǎn)載,請(qǐng)注明出處:http://m.kgzw.cn/product/41.html

更新時(shí)間:2026-03-15 12:29:32